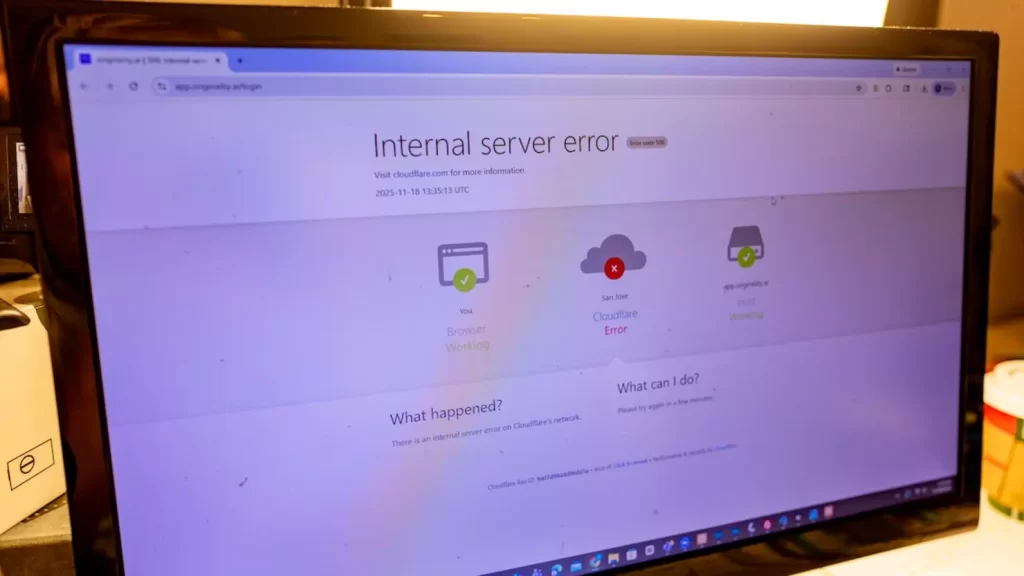

Cloudflare 當機,今日香港時間下午再度出現大規模故障,全球數百萬網站同時拋出500 內部伺服器錯誤,受影響服務包括 Dcard、Canva、Zoom 等常用平台,而 Cloudflare 本身盤前股價一度急挫近 6%,投資者對其穩定性響起警號。更令人震驚的是,這已是該公司一個月內第二次大型事故,現代網絡架構的脆弱性再次暴露人前。

半小時故障 數百萬網站都受到影響

今日下午,香港及亞洲的用戶陸續發現 Dcard、Canva、Zoom 等服務無法正常訪問,畫面彈出500 內部伺服器錯誤。Cloudflare 在其狀態頁面上確認,此次事故是由於其 Dashboard 及相關 API 出現服務問題,導致使用這些服務的網站請求失敗或直接出現錯誤。事故持續約半小時後,Cloudflare 表示已實施修復措施並持續監控系統狀態。對一般用戶而言,眼前感受就是所有網站都無法訪問,無論是開 Zoom 會議、用 Canva 設計社交媒體圖片,還是上論壇討論,全部瞬間斷線。

一個月內兩起重大事故,脆弱的骨幹再次敲響警鐘。

值得留意的是,這已是 Cloudflare 一個月內第二次的大型事故。11 月中旬,該公司因為 Bot Management 配置錯誤,導致大量流量路由崩潰,當時同樣造成網站全面回應 500 錯誤,規模相當驚人。Cloudflare 作為全球最大的 CDN 和網絡安全供應商之一,為百萬計的網站提供內容傳遞、DDoS 防護、DNS、反向 proxy 等服務,簡單來說就是 互聯網背後的水喉與閘門。當越來越多的網站集中使用同一間基礎設施供應商,任何內部錯誤或配置更新失誤,都足以引發全球的連鎖反應,這次甚至讓監察服務狀態的 DownDetector 自己都一度無法訪問。

盤前股價急速下跌,可靠性受到質疑。

事故一出,Cloudflare 於美股盤前即時受壓,股價最初一度下挫近 6%,之後跌幅略為收窄。雖然 Cloudflare 仍然是雲安全及 CDN 版圖中的重要玩家,市值約 750 億美元,但接連兩次大型事故無可避免為其可靠性貼上問號。今次故障初步確認並非外來攻擊,而是內部更新引發的錯誤流程,與早前 11 月的配置問題同樣屬搞錯自己的事情,這種性質對長線投資者而言更加敏感。市場擔心,如果 Cloudflare 在變更流程、測試機制及冗餘設計上無明顯改善,類似事故未來可能再重演,屆時對品牌及股價都會造成更深遠打擊。

香港企業與用戶如何應對

對香港本地用戶及網店老闆來說,Cloudflare 出事未必會立即讓人轉換供應商,但一定會令大家重新檢視風險。很多中小企業、網店,甚至內容網站都使用 Cloudflare 提供 DDoS 防護、SSL、CDN,不僅價格合理,設定也簡單。但這次事件再次證明了平靚正的背後都隱藏著一個單一的故障點。。對技術團隊而言,下一步應該考慮多雲及多 CDN 策略,例如關鍵服務同時配置第二條直連路線或備用 DNS/CDN,這樣至少當某一供應商出現大規模故障時,可以迅速轉移部分流量,減少對用戶的影響。一般用戶雖然未必能選擇背後使用哪間 CDN,但至少要意識到,當某個網站無法開啟時,問題很多時不在於你的路由器,而是全球骨幹層面出事,以免白白重啟數據機或責怪 ISP。

Cloudflare 當機後,下一步如何自救

Cloudflare 在最新更新中指出,這次 Dashboard/API 故障已經修復,相關服務陸續恢復正常,並強調將持續監控系統狀態,以防再出現間歇性問題。然而,在經歷了 11 月和 12 月的兩次大規模事故後,市場更關心的是 Cloudflare 如何改變內部變更流程,例如加強 Canary 測試、限制高風險時間的變更,或將關鍵模組拆分,以避免單一錯誤拖垮整個網絡。對於香港的讀者來說,短期內最實際的做法是:遇到 App 或網站突然大範圍出現 500 Error 時,不妨先查看監控平台或社交媒體上的關鍵字,確認是否 Cloudflare 又出事情了,而不是盲目重裝 App 或責怪本地 ISP。在中長期方面,如果您負責網站或 App,真的需要開始考慮一套 CDN 出事 計畫 B,否則每次全球大停機時,您的生意也將被迫按下暫停鍵。